Easy methods to earn money with SEO | Manuel Zuri TV

Warning: Undefined variable $post_id in /home/webpages/lima-city/booktips/wordpress_de-2022-03-17-33f52d/wp-content/themes/fast-press/single.php on line 26

Make Seo , How to make money with search engine marketing | Manuel Zuri TV , , NhNuYwHppQE , https://www.youtube.com/watch?v=NhNuYwHppQE , https://i.ytimg.com/vi/NhNuYwHppQE/hqdefault.jpg , 5 , 5.00 , Lion's Coronary heart Circle - our Power Neighborhood. Get information & access with eMail here: https://manuelzuritv.dwell/lion Manuel Zuri reveals you ... , 1655543121 , 2022-06-18 11:05:21 , 02:07:53 , UCZG7JhLeFUVZcJDX2JPPx2w , Manuel Zuri TV , 1 , , [vid_tags] , https://www.youtubepp.com/watch?v=NhNuYwHppQE , [ad_2] , [ad_1] , https://www.youtube.com/watch?v=NhNuYwHppQE, #money #website positioning #Manuel #Zuri [publish_date]

#cash #website positioning #Manuel #Zuri

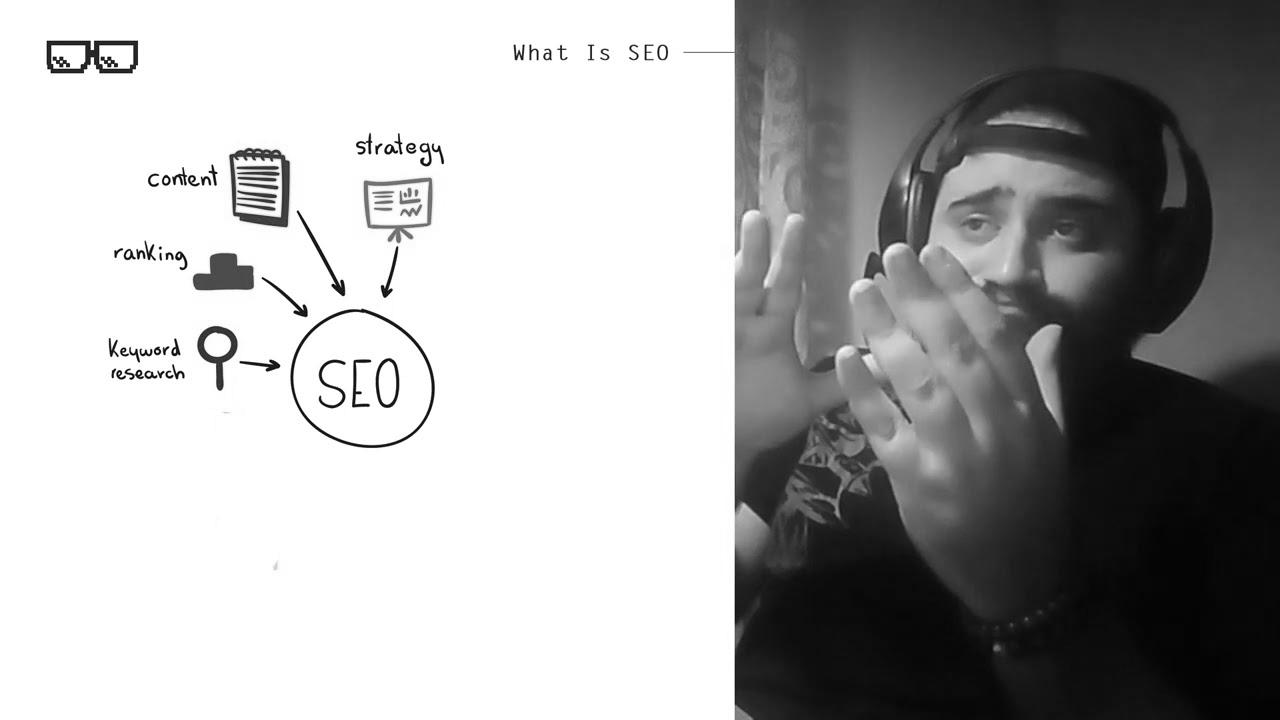

Lion's Coronary heart Circle - our Power Community. Get information & access with eMail right here: https://manuelzuritv.live/lion Manuel Zuri shows you ...

Quelle: [source_domain]

- Mehr zu SEO Mitte der 1990er Jahre fingen die aller ersten Suchmaschinen im Netz an, das frühe Web zu erfassen. Die Seitenbesitzer erkannten rasch den Wert einer nahmen Positionierung in Serps und recht bald fand man Anstalt, die sich auf die Verfeinerung qualifitierten. In Anfängen bis zu diesem Zeitpunkt die Aufnahme oft über die Übermittlung der URL der jeweiligen Seite in puncto vielfältigen Suchmaschinen im Internet. Diese sendeten dann einen Webcrawler zur Analyse der Seite aus und indexierten sie.[1] Der Webcrawler lud die Website auf den Server der Recherche, wo ein 2. Software, der gern genutzte Indexer, Infos herauslas und katalogisierte (genannte Ansprüche, Links zu weiteren Seiten). Die zeitigen Typen der Suchalgorithmen basierten auf Infos, die anhand der Webmaster selber vorgegeben werden, wie Meta-Elemente, oder durch Indexdateien in Suchmaschinen im WWW wie ALIWEB. Meta-Elemente geben eine Übersicht via Gegenstand einer Seite, jedoch setzte sich bald hoch, dass die Anwendung er Ratschläge nicht vertrauenswürdig war, da die Wahl der eingesetzten Schlüsselworte durch den Webmaster eine ungenaue Abbildung des Seiteninhalts spiegeln vermochten. Ungenaue und unvollständige Daten in Meta-Elementen vermochten so irrelevante Seiten bei speziellen Stöbern listen.[2] Auch versuchten Seitenersteller verschiedenartige Punkte binnen des HTML-Codes einer Seite so zu beeinflussen, dass die Seite größer in den Ergebnissen gefunden wird.[3] Da die neuzeitlichen Suchmaschinen im Internet sehr auf Faktoren abhängig waren, die einzig in den Taschen der Webmaster lagen, waren sie auch sehr labil für Missbrauch und Manipulationen im Ranking. Um vorteilhaftere und relevantere Testurteile in den Ergebnissen zu bekommen, musste ich sich die Unternhemer der Internet Suchmaschinen an diese Faktoren angleichen. Weil der Triumph einer Suchseiten davon abhängt, relevante Suchresultate zu den inszenierten Suchbegriffen anzuzeigen, vermochten ungünstige Urteile dazu führen, dass sich die User nach sonstigen Möglichkeiten bei dem Suche im Web umschauen. Die Erwiderung der Suchmaschinen im WWW lagerbestand in komplexeren Algorithmen für das Positionierung, die Gesichtspunkte beinhalteten, die von Webmastern nicht oder nur nicht leicht steuerbar waren. Larry Page und Sergey Brin entwickelten mit „Backrub“ – dem Stammvater von Bing – eine Suchseiten, die auf einem mathematischen KI basierte, der mit Hilfe der Verlinkungsstruktur Unterseiten gewichtete und dies in Rankingalgorithmus eingehen ließ. Auch weitere Search Engines betreffend zu Beginn der Folgezeit die Verlinkungsstruktur bspw. wohlauf der Linkpopularität in ihre Algorithmen mit ein. Bing